Голосові асистенти стали настільки звичною частиною нашого життя, що ми вже майже не помічаємо, як часто звертаємося до них. “Окей, Google, яка сьогодні погода?”, “Привіт, Siri, постав будильник”, “Alexa, увімкни світло” – ці фрази щодня мільйони разів запускають складні процеси, що перетворюють хаотичні звукові хвилі на чіткі команди. Технології розпізнавання мови (Speech Recognition), які лежать в основі цих асистентів, пройшли шлях від громіздких лабораторних експериментів до компактних, майже бездоганних систем. Вони змінили наше спілкування з гаджетами, будинком і навіть автомобілем. Зрозуміти, як саме працює цей “розумний слухач” і які виклики та фантастичні можливості чекають на цю сферу в найближчому майбутньому, – ключ до усвідомленого використання сучасних технологій. Про механізми, що стоять за голосовими асистентами, а також про перспективи їхньої інтеграції в наше повсякдення, читайте далі на i-kherson.com.

Анатомія розпізнавання мови: від звуку до команди

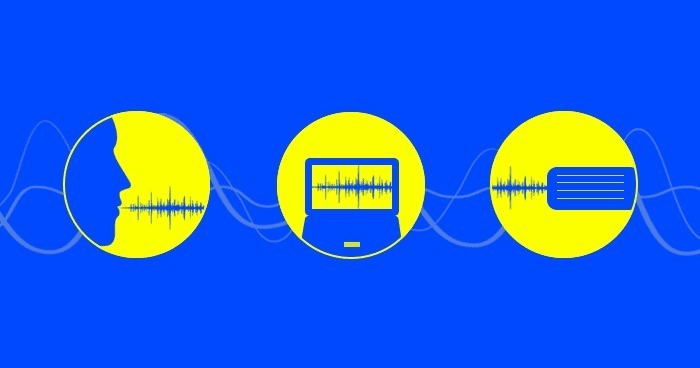

Процес перетворення мови в текст (Automatic Speech Recognition, ASR) – це багатоетапна подорож, яка займає частки секунди. Кожен голосовий помічник, будь то Siri, Alexa, Google Assistant чи інший, використовує схожу, хоча й запатентовану, архітектуру. Цей процес можна розділити на чотири ключові стадії, кожна з яких використовує складні алгоритми машинного навчання.

1. Акустичний аналіз та попередня обробка

Коли ви вимовляєте ключове слово активації (“Hey Siri” або “Alexa”), мікрофон починає запис. Перші кроки – це очищення та підготовка даних:

- Виділення голосового сигналу: Алгоритми повинні відокремити ваш голос від фонового шуму (музики, шуму вулиці, розмов).

- Перетворення аналогового сигналу в цифровий: Людська мова – це аналоговий сигнал. Система перетворює його в цифрову форму (одиниці та нулі).

- Фреймінг (Segmentation): Мова розбивається на короткі, крихітні сегменти – фрейми (близько 10-25 мілісекунд), оскільки звуки швидко змінюються.

- Вилучення ознак (Feature Extraction): Найважливіший етап. Система аналізує спектр звуку для виявлення фонем – мінімальних одиниць мови. Для цього часто використовується Мель-частотні кепстральні коефіцієнти (MFCC), які допомагають уявити звукові дані в більш компактному вигляді, придатному для моделі.

2. Акустична модель

Акустична модель – це мозок ASR. Вона відповідає на питання: “Яка фонема (звук) була вимовлена?”. Вона використовує величезні масиви даних (мільйони годин записів людської мови), щоб зіставити виявлені звукові ознаки з імовірними фонемами. Історично використовувалися приховані марковські моделі (HMM), але сьогодні домінують глибокі нейронні мережі (Deep Neural Networks, DNN), зокрема рекурентні нейронні мережі (RNN) та трансформатори. Ці моделі здатні працювати з контекстом і значно підвищили точність розпізнавання.

3. Мовна модель

Мовна модель відповідає за контекст. Вона знає, які слова і фрази найімовірніше йдуть одне за одним. Наприклад, після слова “погода” найімовірніше йде “сьогодні” або “завтра”, а не “котячий” чи “зелений”. Ця модель працює з граматикою, синтаксисом і словниковим запасом. Вона коригує помилки, зроблені акустичною моделлю, обираючи найбільш логічний ланцюжок слів. Моделі також стали складнішими, перейшовши від простих N-грам до великих мовних моделей (LLMs), які використовують трансформерні архітектури для розуміння дуже довгого і складного контексту.

4. Інтерпретація (NLU) та виконання

Після того, як мова перетворена в текст, вступає в дію модуль Розуміння природної мови (Natural Language Understanding, NLU). NLU не просто знаходить слова, воно визначає намір (Intent) користувача та сутності (Entities). Наприклад:

- Фраза: “Скільки коштує квиток до Херсону на завтра?”

- Намір (Intent): “Пошук рейсу/квитка”.

- Сутності (Entities): Місто призначення (“Херсон”), Дата (“завтра”), Предмет (“квиток”).

Нарешті, команда передається на виконання, асистент формує відповідь (яка може бути синтезована голосом – Text-to-Speech, TTS) та виконує запит, наприклад, запускає пошук. У контексті цифрової безпеки та ідентифікації, цікаво, що технології розпізнавання мови можуть використовуватися для біометричної ідентифікації, так само, як і блокчейн-ідентифікація – технологія, що може захистити ваші персональні дані та замінити паспорти, додаючи новий рівень безпеки.

Чому голосові асистенти іноді помиляються: Виклики ASR

Незважаючи на прогрес, навіть найкращі системи розпізнавання мови не є ідеальними. Точність розпізнавання (Word Error Rate, WER) постійно зростає, але існують фундаментальні проблеми, які ускладнюють завдання.

Головні перешкоди на шляху до ідеального розпізнавання

- Акустичний шум: Найбільший ворог. Галаслива вулиця, шум вітру, або одночасна розмова кількох людей можуть збити модель, оскільки їй важко ізолювати цільовий голос.

- Акцент та діалекти: Моделі, навчені на стандартній мові, можуть мати труднощі з розпізнаванням сильних регіональних акцентів, сленгу або діалектних слів.

- Омофони та контекст: Слова, які звучать однаково, але мають різне значення (наприклад, “коса” – зачіска, знаряддя чи смуга землі). Якщо мовна модель не має достатньо контексту, вона може помилитися.

- Нестандартна термінологія: Імена, назви брендів, технічні терміни, які не входять до словника мовної моделі, часто розпізнаються неправильно.

- Перемикання мови (Code-switching): Коли людина в одній фразі переходить з однієї мови на іншу, сучасні ASR моделі часто не справляються.

Один із способів підвищити точність і корисність асистентів – це їхня інтеграція в екосистему розумного будинку. Наприклад, як ми прагнемо до відновлюваної енергії у побуті (сонячні панелі на балконі), так і голосові системи прагнуть до енергоефективності, мінімізуючи обробку даних на сервері.

Майбутнє технологій розпізнавання мови: LLM, Edge AI та біометрія

Ера простих голосових команд добігає кінця. Майбутнє належить контекстуально-обізнаним, проактивним та персоніфікованим асистентам. Кілька ключових технологічних трендів визначають цей напрямок.

Інтеграція з великими мовними моделями (LLM)

- Контекстуальна пам’ять: Асистенти зможуть пам’ятати деталі попередніх запитів і підтримувати діалог протягом тривалого часу. Вони не просто відповідатимуть на окреме питання, а братимуть участь у розмові, що триває.

- Генеративні відповіді: Замість заздалегідь прописаних відповідей, LLM дозволять асистентам генерувати унікальні, природні та складні відповіді, робити висновки та узагальнювати інформацію, як це робить людина.

- Покращене розуміння намірів: LLM значно поліпшать NLU, дозволяючи асистентам розуміти нечіткі, саркастичні або складні, багатошарові запити.

Edge AI та приватність

Одним із головних недоліків сучасних асистентів є те, що більшість обробки даних відбувається на віддалених серверах (Cloud Computing). Це викликає занепокоєння щодо приватності. Майбутнє за Edge AI – технологією, яка дозволяє виконувати розпізнавання та обробку голосових даних безпосередньо на пристрої (телефоні, колонці, годиннику), не відправляючи їх до хмари. Це робить роботу асистента швидшою, надійнішою та значно безпечнішою з точки зору особистих даних. Це переломний момент для технології.

Біометричне розпізнавання голосу

Голос – це унікальний біометричний ідентифікатор. Системи майбутнього не лише розумітимуть, що ви говорите, але й хто це говорить. Це відкриє можливості для:

- Персоналізованих послуг: Асистент автоматично розпізнає вас і надає доступ до ваших особистих даних, календарів, банківських рахунків без додаткових паролів, що може бути інтегровано з концепцією блокчейн-ідентифікації.

- Батьківського контролю: Розпізнавання голосу дитини може автоматично обмежувати доступ до певного контенту.

- Безпеки: Голосова аутентифікація може замінити PIN-коди та паролі для доступу до високочутливих систем.

Етичні дилеми та виклики приватності

Зі зростанням можливостей голосових асистентів, зростає і занепокоєння. Асистент, який постійно “слухає” (“always on”), збирає величезний масив даних про наше особисте життя. Питання про те, де зберігаються ці записи, як вони використовуються для навчання моделей і хто має до них доступ, залишаються відкритими. Тут важливо, щоб користувачі розуміли, як працює функція “очищення” записів і як технології енергозбереження допомагають зменшити навантаження на дата-центри, що зберігають ці дані.

| Параметр | Поточний стан (2025) | Майбутні тренди (2030+) |

|---|---|---|

| Модель обробки | Переважно Cloud Computing (хмара) | Edge AI (обробка на пристрої) |

| Контекст | Короткий (1-2 попередні запити) | Довгий (пам’ять діалогу, зв’язок між сесіями) |

| Тип моделі | DNN + N-gram/Прості LLM | Великі Трансформерні LLM |

| Ідентифікація | Розпізнавання тексту | Розпізнавання тексту + Біометрія голосу (хто говорить) |

| Відповіді | Скриптовані або прості генеративні | Складні, унікальні, людиноподібні, проактивні |

Технології розпізнавання мови знаходяться на порозі нової революції, перетворюючись з простого інструменту на повноцінних інтелектуальних співрозмовників. Незалежно від того, чи керуємо ми світлом, чи шукаємо інформацію, чи просто розважаємося, наші голосові помічники стають розумнішими, швидшими та, що найголовніше, ближчими до розуміння людини. Це захоплююча подорож у світ, де межа між людиною і машиною стає все більш розмитою.